近年、生成AIの技術革新は私たちの仕事や日常生活に革命をもたらしています。ChatGPTや画像生成AIなどの進歩は、無限の可能性を秘めている一方で、新たなセキュリティリスクや法的課題を引き起こしています。

この記事では、生成AIのセキュリティリスクを深く掘り下げ、企業や個人がこれらのリスクを理解し、効果的に管理する方法を探求します。生成AIの安全な活用を目指すすべての人にとって、必読の内容を提供します。

生成AIの普及とその影響

生成AIは、テキスト、画像、音声などのコンテンツを自動生成する革新的な技術です。ビジネス、教育、エンターテイメントなど多岐にわたる分野でその利用が拡大しています。しかし、この急速な普及は、セキュリティリスクや法的課題をもたらしています。

生成AIの基本的な概念と用途

生成AIは、大量のデータを基に新しいコンテンツを生成するAI技術です。テキスト生成、画像生成、音声生成など、多様な用途で活用されています。

生成AIの普及とその影響

生成AI(Generative Artificial Intelligence)は、デジタルトランスフォーメーションの最前線に立つ技術として、近年急速に普及しています。この技術は、大量のデータから学習し、新しいテキスト、画像、音声などのコンテンツを自動で生成する能力を持っています。生成AIの応用範囲は広く、ビジネス文書の作成、グラフィックデザイン、教育コンテンツの開発、エンターテイメント産業など多岐にわたります。

この技術の進化により、企業や個人は効率化とイノベーションの大きな機会を得ています。例えば、生成AIを活用することで、時間を要する作業を自動化し、創造的なプロセスを加速することが可能になります。しかし、この急速な普及は、セキュリティリスクや倫理的な問題、法的な課題をもたらすことも事実です。

生成AIの基本的な概念と用途

生成AIは、機械学習の一形態であり、特にディープラーニング技術を活用しています。このAIは、大量のデータを分析し、そのデータセット内のパターンを学習します。そして、新しいデータ(テキスト、画像、音声など)を生成する際に、これらのパターンを基にして創造的な出力を行います。

用途としては、以下のような分野で特に注目されています。

- テキスト生成: ビジネス文書、ニュース記事、創作物などのテキストコンテンツを生成します。

- 画像生成: 芸術作品、グラフィックデザイン、アニメーションなどのビジュアルコンテンツを作成します。

- 音声生成: 音声アシスタント、オーディオブック、音楽作成などのオーディオコンテンツを生成します。

生成AIのこのような多様な用途は、ビジネスや社会に革新をもたらす一方で、新たなリスクを生み出す原因ともなっています。次のセクションでは、これらのセキュリティリスクについて詳しく掘り下げていきます。

生成AIは、大量のデータを基に新しいコンテンツを生成するAI技術です。テキスト生成、画像生成、音声生成など、多様な用途で活用されています。

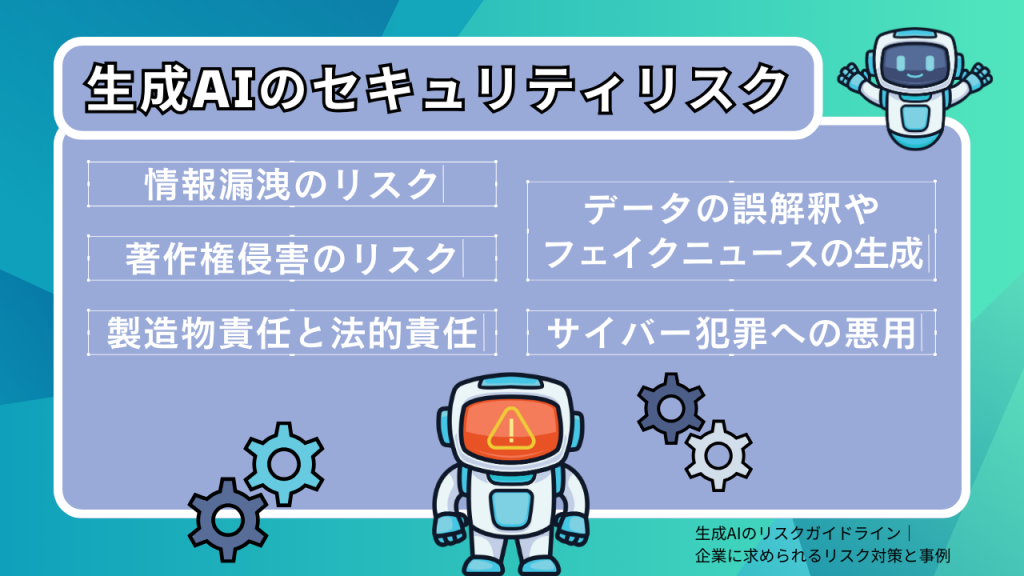

生成AIのセキュリティリスク

生成AIの急速な発展は多くの機会をもたらしていますが、同時に新たなセキュリティリスクも引き起こしています。これらのリスクは、個人のプライバシー、知的財産権、さらには法的責任に関わる問題を含んでおり、企業や個人が生成AIを利用する際には特に注意が必要です。

情報漏洩のリスク

生成AIはユーザーからの入力データを基に学習を行います。このプロセス中に、機密情報や個人データが含まれている場合、それらが外部に漏れるリスクがあります。特に、企業が内部情報をAIに入力する場合、そのデータが予期せず外部に露出する可能性があり、重大な情報漏洩につながる恐れがあります。

著作権侵害のリスク

生成AIが学習するデータには、著作権で保護されているコンテンツが含まれることがあります。AIがこれらのデータを基に新しいコンテンツを生成する際、著作権侵害の問題が生じる可能性があります。これは、特にクリエイティブな分野でのAIの利用において顕著な問題となり得ます。

製造物責任と法的責任

生成AIによって引き起こされる損害に対して、製造者や提供者が法的責任を負う可能性があります。AIが誤った情報や不適切なコンテンツを生成した場合、その結果に対する責任を問われることがあります。これは、企業が生成AIを利用する際に特に考慮すべきリスクです。

データの誤解釈やフェイクニュースの生成

生成AIは、時に誤った情報や誤解を招くコンテンツを生成することがあります。これは「ハルシネーション」と呼ばれ、AIが不正確なデータや不完全な情報に基づいて結論を導くことによって発生します。また、フェイクニュースの生成と拡散にも利用されるリスクがあり、社会的な混乱を引き起こす可能性があります。

サイバー犯罪への悪用

生成AIの高度なテキスト生成能力は、詐欺メールの作成やマルウェアの開発に悪用される可能性があります。自然言語処理の能力を利用して、より説得力のあるフィッシング攻撃や、セキュリティシステムを回避するための高度なマルウェアを作成することが懸念されています。

事例1:犯罪集団が自ら生成AIを開発、NTTデータが明かす2023年のサイバー攻撃実態|日経クロステック

事例2:Google、2024年にAI強化型生成攻撃、ゼロデイエクスプロイト利用の急増を警告(英語)|Cyber Security Hub

これらのリスクを理解し、適切に対処することは、生成AIを安全かつ効果的に利用するために不可欠です。次のセクションでは、これらのリスクに対するマネジメント戦略について詳しく掘り下げていきます。

生成AIのリスクマネジメント

生成AIの利用が拡大する中で、企業はこれらの新たなリスクを適切に管理することが重要です。リスクマネジメントは、生成AIの安全な利用を確保し、潜在的な問題を未然に防ぐための鍵となります。

企業におけるリスクマネジメントの重要性

企業が生成AIを利用する際には、様々なセキュリティリスクや法的な問題に直面する可能性があります。これらのリスクを効果的に管理することは、企業の信頼性を保ち、法的な問題や財務的な損失を避けるために不可欠です。リスクマネジメントは、これらの問題を特定し、評価し、対処するプロセスを含みます。

リスクマネジメントのポイント

- サービス提供者の責任: 生成AIを提供する企業は、その出力の正確性や適切性に対して一定の責任を負います。不正確な情報や不適切なコンテンツが生成された場合、企業はその責任を問われる可能性があります。

- 権利侵害と情報漏洩のリスク: 生成AIが著作権で保護されたコンテンツを無断で使用することや、機密情報を漏洩させるリスクを管理する必要があります。

- 既存法との抵触: 生成AIの利用が既存の法律や規制に違反する可能性があります。特に、データ保護法や知的財産権に関連する法律に注意が必要です。

企業におけるリスクマネジメントの実践

企業は、リスクマネジメントのプロセスを確立し、以下のような対策を講じることが推奨されます。

- リスク評価: 生成AIに関連するリスクを特定し、評価する。

- ポリシーと手順の策定: 生成AIの安全な利用に関するポリシーと手順を策定し、従業員に教育する。

- 監視とレビュー: 生成AIの利用を定期的に監視し、リスクマネジメントの戦略をレビューする。

- 法的コンプライアンスの確保: 生成AIの利用が法的要件に適合していることを確認する。

生成AIのリスクマネジメントは、企業がこの革新的な技術を安全かつ効果的に利用するための基盤を提供します。次のセクションでは、具体的なセキュリティ対策について詳しく説明します。

リスクマネジメントには、サービス提供者の責任、権利侵害と情報漏洩のリスク、既存法との抵触などが含まれます。

記事を読んでいる方におすすめの資料はこちらにまとめています。

生成AIのセキュリティ対策

生成AIの利用が拡大するにつれて、それに伴うセキュリティリスクへの対策が不可欠となっています。ここでは、利用者としてのセキュリティ対策、攻撃者としてのセキュリティ対策、そして企業におけるセキュリティ対策の実例について掘り下げます。

利用者としてのセキュリティ対策

生成AIの利用者は、特にデータのプライバシーとセキュリティに注意を払う必要があります。以下の対策が考えられます。

- 機密情報の取り扱い: 生成AIに機密情報を入力しないようにする。

- データの安全な管理: 入力データの安全性を確保し、不適切な情報の漏洩を防ぐ。

- 利用規約の理解: 生成AIサービスの利用規約を理解し、適切な使用を心がける。

攻撃者としてのセキュリティ対策

生成AIがサイバー攻撃に悪用されるリスクに対しては、以下の対策が必要です。

- フィルタリングと監視: 生成AIを通じた不審な活動や不適切なコンテンツの生成を監視し、必要に応じてフィルタリングする。

- セキュリティプロトコルの強化: 生成AIを利用するシステムに対するセキュリティプロトコルを強化する。

企業におけるセキュリティ対策の実例

企業は、以下のようなセキュリティ対策を実施しています。

- 社内ポリシーの策定: 生成AIの利用に関する社内ポリシーを策定し、従業員に教育する。

- アクセス管理: 生成AIへのアクセスを厳格に管理し、不正アクセスを防ぐ。

- リスク評価と監視: 生成AIの利用に関連するリスクを定期的に評価し、監視する。

- データ保護技術の導入: 機密情報の保護とデータ漏洩の防止のための技術を導入する。

これらの対策は、生成AIを安全に利用し、その潜在的なリスクを最小限に抑えるために不可欠です。次のセクションでは、生成AIの安全な活用について詳しく説明します。

企業は、生成AIの利用において、データの取り扱いやアカウント管理などのセキュリティ対策を実施する必要があります。

生成AIの安全な活用

生成AIのポテンシャルを最大限に活用しつつ、セキュリティリスクを管理するための戦略は、企業にとって重要な課題です。以下では、生成AIの安全な利用に向けた具体的なアプローチを探ります。

生成AIセキュリティリスクマネジメント支援

専門的なサポートを通じて、生成AIのリスクを最小限に抑えることが可能です。これには、以下のような活動が含まれます。

- リスク評価: 生成AIに関連するリスクを特定し、評価する。

- セキュリティ対策の策定: データのプライバシー保護、偽情報の識別などに対応するセキュリティ対策を策定する。

- 教育とトレーニング: 従業員に対する生成AIの安全な利用に関する教育とトレーニングを提供する。

ビジネスにおける安全な生成AIの導入

企業は、生成AIをビジネスプロセスに導入する際に、以下の点を考慮する必要があります。

- ガイドラインの策定: 生成AIの利用に関する社内ガイドラインを策定し、従業員に周知する。

- データ管理: 生成AIに入力するデータの管理を徹底し、機密情報の漏洩を防ぐ。

- コンプライアンスの確保: 法的規制や業界基準に準拠した生成AIの利用を確保する。

なお、専門業者と提携することで、セキュリティやコンプライアンスを遵守したスムーズな導入が可能です。おすすめの専門業者については以下をご覧ください。

▼あわせて読みたい

生成AI活用支援おすすめ企業4選。選び方を徹底解説!

生成AI利用ガイドラインの策定

安全な生成AIの利用には、明確なガイドラインの策定が不可欠です。これには、以下の要素が含まれます。

- データ取り扱い: 生成AIの学習に利用されるデータの取り扱いに関するガイドラインを設定する。

- アカウント管理: 生成AIサービスのアカウント管理に関するポリシーを策定し、適切な管理を行う。

これらのアプローチにより、企業は生成AIを安全に利用し、その潜在的なリスクを効果的に管理することができます。次のセクションでは、これらの点を踏まえたまとめと、今後の展望について考察します。

生成AIの安全な利用に向けたガイドラインの策定が重要です。

生成AIのリスクについて企業担当者が考えるべきこと

生成AIは、その革新的な能力により、ビジネスや社会に多大な影響を与えています。この技術は、効率化、創造性の向上、新しい機会の創出など、数多くの利点を提供します。しかし、同時に情報漏洩、著作権侵害、法的責任、データの誤解釈、サイバー犯罪への悪用といったセキュリティリスクも伴います。

企業や個人がこれらのリスクを理解し、適切に管理することは、生成AIを安全かつ効果的に利用するために不可欠です。リスクマネジメントのプロセスを確立し、セキュリティ対策を講じることで、これらのリスクを最小限に抑えることが可能です。また、生成AIの利用に関する明確なガイドラインの策定は、企業がこの技術を安全に活用する上で重要な役割を果たします。

今後、生成AIの技術はさらに進化し、その利用範囲も広がることが予想されます。この進化に伴い、リスク管理の重要性も高まるでしょう。企業は、生成AIのリスクと機会をバランス良く取り扱い、この革新的な技術を最大限に活用するための戦略を継続的に見直し、適応していく必要があります。生成AIの安全な利用とリスクマネジメントは、今後のビジネスと社会において重要なテーマとなるでしょう。

生成AIのリスクチェックシート(企業編)

生成AIを活用する上でどのような炎上リスクに注意すべきなのかを見やすいチェックシートだよ!

どんな人におすすめなの?

こんな人におすすめです!

・生成AIを導入したいが、セキュリティリスクが不安

・トラブル発生時の対応フローが不安

文化庁の生成AIに関する議事の要約|配布資料PDFを参考

文化庁では、令和5年12月20日(水)の10:00~12:00に文武科学省東館3F1特別会議室にて、文化審議会著作権分科会法制度小委員会(第5回)が開催されました。

生成AIを活用するクリエイターは必見!

生成AIに関する著作権に関する要約

要約元の参考PDF(文化庁)

文化庁|生成と著作権に関する考え方について(素案)

関連する生成AIに関するPDF(文化庁)

第23期 文化審議会 著作権分科会 法制度小委員会 委員名簿 (令和5年7月26日現在)

生成 AI に関するクリエイターや著作権者等の主な御意見(未定稿)|2023 年 11 月現在

法30条の3と法47条の5の適用例について

論点整理|これまでの議論の振り返り|AI時代の知的財産権検討会

広島 AI プロセス等における著作権関係の記載について

文化審議会著作権分科会法制度小委員会|開催実績及び今後の進め方(予定)

生成AIの利用ガイドライン

生成AIの利用ガイドラインは、一般社団法人である日本ディープラーニング協会(JDLA)が『生成AIの利用ガイドライン』の第1版(2023年5月1日公開)に改訂を加えた第1.1版を公開しました。

日本ディープラーニング協会は、ディープラーニングを事業の核とする企業が中心となり、ディープラーニング技術を日本の産業競争力につなげていこうという意図のもとに設立されました。ディープラーニングを事業の核とする企業および有識者が中心となって、産業活用促進、人材育成、公的機関や産業への提言、国際連携、社会との対話 など、産業の健全な発展のために必要な活動を行っています。

一般社団法人 日本ディープラーニング協会 『生成AIの利用ガイドライン』第1.1版を公開

一般社団法人の日本ディープラーニング協会が公開した「生成AIの利用ガイドライン」です。

内閣府のホームページにて公表された「新AI事業者ガイドライン スケルトン(案)」です。本資料は、AI戦略会議第5回にて掲載されているPDFです。

行政が発表した生成AIのセキュリティリスクへの対応に関するガイドライン以外にも、企業が公開した資料があります。NRIセキュアテクノロジーズでは、「生成AIのセキュリティリスクと対応のあり方」について解説しています。

以上、「生成AIのリスクガイドライン|企業に求められるリスク対策と事例」でした。新しい情報が公開されたら更新致しますが、確認すべき資料が多く閲覧しきれなかった方はブックマークしておきましょう。

コメント